对比损失是一种降维学习方法,它可以学习一种映射关系,这种映射关系可以使得在高维空间中,相同类别但距离较远的点,通过函数映射到低维空间后,距离变近,不同类别但距离都较近的点,通过映射后再低维空间变得更远。这样的结果就是,在低维空间,同一种类的点会产生聚类的效果,不同种类的mean会隔开。类似fisher降维,但fisher降维不具有out-of-sample extension的效果,不能对new sample进行作用。

为什么需要对比损失函数传统上,维度减小包括将一组高维输入点映射到低维manifold上,使得输入空间中的“相似”点被映射到manifold上的附近点。经典的降维方法是主成分分析(PCA)和多维缩放(MDS)。 PCA将样本点投影到子空间中,其中样本点的方差最小化。 MDS将样本投影到子空间中,该子空间最好保留输入点之间的成对距离。另一种降维方法是ISOMAP和局部线性嵌入(LLE)。所有上述方法都预先假定输入空间中存在有意义的度量,计算过程通常有三个步骤:1。识别每个点的邻域列表。 2.使用该信息计算克矩阵。 3.该矩阵求解了特征值问题。

这些方法都没有尝试计算可以映射新的未知数据点的函数,而无需重新计算整个嵌入,也不知道它与训练点的关系。1

优点它只需要训练样本之间的邻域关系。 这些关系可能来自先前知识或手动标记,并且与任何距离度量无关。

它可以学习对输入的复杂非线性结构不变的函数,例如照明变化和几何失真。

学习的函数可用于映射在训练期间未见的新样本,而没有先验知识。

由函数生成的映射在某种意义上是“平滑的”并且在输出空间中是连贯的。

原理让我们考虑一对样本 令

令 是分配给该对的二进制标签。如果

是分配给该对的二进制标签。如果 和

和 被认为是相似的,则

被认为是相似的,则 ,如果认为它们不相同,则

,如果认为它们不相同,则 。在

。在 ,

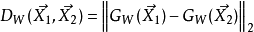

, 之间定义要学习的参数化距离函数,作为

之间定义要学习的参数化距离函数,作为 输出之间的欧氏距离。那是:

输出之间的欧氏距离。那是:

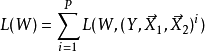

一般形式是:

其中 是标记的样本对,是标记的样本对,

是标记的样本对,是标记的样本对, 是部分失效对象的相似点,

是部分失效对象的相似点, 是不相似点的部分损失函数,P是训练对的数量(可以与样本数的平方一样大)。

是不相似点的部分损失函数,P是训练对的数量(可以与样本数的平方一样大)。

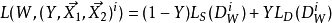

和

和 必须设计成使得相对于WW最小化

必须设计成使得相对于WW最小化 将导致类似对的

将导致类似对的 值较低而不相似对的

值较低而不相似对的 值较高。

值较高。

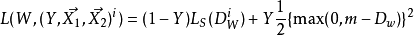

例如,最后的损失函数是:

本词条内容贡献者为:

王慧维 - 副研究员 - 西南大学

扫码下载APP

扫码下载APP

科普中国APP

科普中国APP

科普中国

科普中国

科普中国

科普中国