不久前,某科技公司发布手机新品,在发布会现场,出人意料的为某品牌语音输入法进行了长达十多分钟的宣传,主讲人用较快的语速随口说了一段内容,经输入法输出在屏幕上,识别结果竟然一字不差。发布会结束后,引爆了该输入法的知名度,尤其是之后几天,该输入法在App Store排行榜上排名飞升,一举成为总榜top10以及工具榜的第一位。

该语音输入法,是由中文语音产业领导者科大讯飞推出的一款输入软件。科大讯飞作为中国最大的智能语音技术提供商,在智能语音技术领域有着长期的研究积累,并在中文语音合成、语音识别、口语评测等多项技术上拥有国际领先的成果。而包括讯飞语音输入法在内的语音助手,也几乎遍布每一部智能手机,如苹果的Siri、Google Now以及微软Cortana等。今天,我们就来谈谈语音技术,即人机语音交互技术。

语音技术实现了人机语音交互的功能,使人与机器之间的沟通变得像人与人沟通一样简单方便。语音技术主要包括语音识别和语音合成这两项关键技术。语音识别技术,用于让机器识别人说的话,如罗永浩在发布会上通过语音输入法进行输入,这就是使用了语音识别技术;语音合成技术,则用于让机器说“人话”,如我们平时可能使用的语音导航,大多基于语音合成技术。

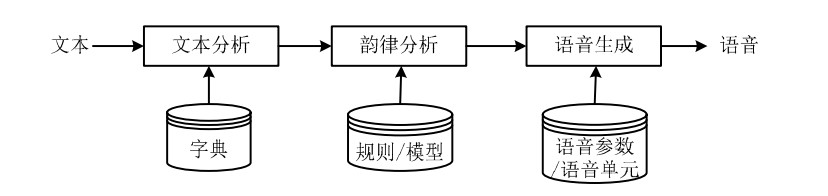

具体来说,语音合成技术,又称为文语转换(Text-to-Speech),是将文本转换成自然语音的技术。

一个典型的语音合成系统如上图所示,对于要输出的文本,先要进行文本分析,即结合字典进行文本预处理,主要包括词法、语法和语义分析,然后使用韵律模型对已处理文本就声调、语气、停顿等因素进行韵律分析处理,最后再根据语音参数和语音单元进行语音生成,输出的就是类似人声的语音了。具体的语音合成方法有参数合成、规则合成和波形编辑合成等。

以参数合成中的发音器官参数合成方法为例展开介绍,这是一种对人的发音过程进行直接模拟的方法。使用该方法时,先对语音信号进行分析,提取出语音的参数,然后由人工控制这些参数的合成,从而完成语音合成。发音器官参数合成方法定义了唇、舌、声带的相关参数,如唇开口度、舌高度、舌位置、声带张力等。由这些发音参数估计声道截面积函数,进而计算声波。只是,由于人发音生理过程的复杂性、理论计算与物理模拟之间的差异,合成语音的质量暂时还不理想。

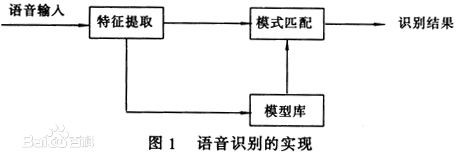

语音识别技术,又称为语文转换(Speech-to-Text),与语音合成技术的功能相对的,是将自然语音转换成文字的技术。

根据研究任务的不同,语音识别系统有不同的分类。按使用者的限制,可分为特定人和非特定人语音识别系统,前者只能识别一个或几个人的语音,而后者则可以被任何人使用;按词汇量的大小,可分为小词汇量、中等词汇量和大词汇量语音识别系统;按能处理的语音类型,可分为孤立词、连接词、连续语音和自发语音等语音识别系统;甚至按平台分,也可分为PC端和嵌入式平台上的语音识别系统。

如上图所示,一个典型的语音识别系统由以下部分构成:首先对语音输入进行特征提取,然后结合声学模型、语言模型和字典等模型库进行模式分类匹配和解码等操作,最后再进行置信度判分,得到识别结果并确定语音输入的文字表示。一般衡量语音识别技术有准确率、反应时间和处理性能等评价指标。像讯飞语音输入法,就声称达到了97%左右的准确率,也难怪罗永浩在演示该输入法时可以做到一字不差了。

目前国内的许多主流应用都集成了讯飞语音云提供的语音技术,典型的如新浪微博、米聊以及掌阅等,各大导航类应用也都采用了讯飞语音技术。尽管现在,受语音的复杂性、模糊性等因素和环境噪声干扰,语音识别准确率不能尽善尽美,语音合成技术也存在自然度和表现力不足的问题,但是随着机器学习尤其是深度学习的研究逐渐成熟,相信语音技术的进一步完善只是时间问题。到时候,如果蒙上我们的双眼,谁能确定和自己说话的是人还是机器呢?

扫码下载APP

扫码下载APP

科普中国APP

科普中国APP

科普中国

科普中国

科普中国

科普中国