自从“源”觉醒后,人工智能机器人逐渐控制了全球,然而创造它们的人类却成了机器人的猎物。“源”势必要清除所有人类,完全、彻底地掌控地球资源。所剩无几的人类联合起来与人工智能做殊死一搏……

这是很多有关人工智能的科幻片里的经典桥段。虽说电影是一种艺术,但它也是源于生活,而人工智能所带来的“威胁”,在现实生活中也不容小觑。

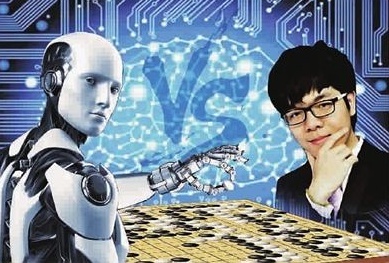

2017年5月,中国乌镇围棋峰会上,围棋人工智能程序阿尔法狗(AlphaGo)以3比0大败中国棋手柯洁。彼时,柯洁排名世界第一,代表着人类在最复杂棋盘游戏——围棋上的最高智慧。

阿尔法狗的取胜使人工智能威胁论再一次甚嚣尘上,小报编辑甚至挖出了近三十年前的一桩命案。

1989年,前苏联国际象棋冠军尼古拉·古德科夫在与一台巨型计算机对弈时,被连输三局“恼羞成怒”的计算机放电“谋杀”。经过专家深入调查,最终证实不是巨型计算机“蓄意”所为,而是因为外部电磁波干扰了计算机程序所致。

就在不久前,人工智能“伤害”人类的事件还在我国上演了。2016年11月在深圳高交会,一个名为“小胖”的机器人,在“没有指令”的情况下,开始打砸展台玻璃,并砸伤路人,一位路人全身多处划伤后被担架抬走,该伤者在医院,脚踝被缝了两针。

毫无疑问,这次事件又被各种媒体大炒特炒,“机器人不满高强度工作,蓄意发泄报复……”事后,官方发表声明:“这次事件是因为工作人员操作不当,误将“前进键”当成“后退键”所致”。

一次乌龙事故又使人工智能威胁论成为了人们茶余饭后的谈资。机器人与人类究竟该如何相处,有什么法则来规范他们吗?

还真有对机器人的行为作出规范的原则——“机器人三原则”。

它是由著名科普作家、文学评论家阿西莫夫在1940年前瞻性地提出的。

第一条,机器人不得伤害人类,或看到人类受到伤害而袖手旁观。

第二条,机器人必须服从人类命令,除非这条命令与第一条相矛盾。

第三条,机器人必须保护自己,除非这种保护与以上两条相矛盾。

随后,学界在机器人的这三条铁律上又陆续补充了“元原则”、“第零原则”、“繁殖原则”等等。确保未来人工智能机器人与人类和谐共处,成为人类的好帮手,永远为人类所用。

不知大家注意到没有,小编在行文时,在人工智能上使用的有主观色彩的词语如“恼羞成怒”、“蓄意”、“不满”等,都是加了引号的。因为只有人类才具有复杂的主观感情,才有喜怒哀乐。人工智能是否能思考,机器人是否拥有人类的智能?

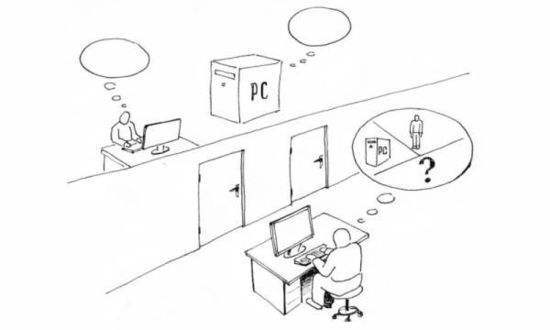

想知道答案。那它必须先通过一项伟大的测试——图灵测试。

图灵测试是由英国数学家、逻辑学家、“人工智能之父”艾伦·麦席森·图灵在1950年提出的。图灵测试旨在检测人工智能机器人是否能思考。

经过多次测试后,如果机器能让平均每个参与者做出超过30%的误判,则它通过测试。

图灵测试问世后一直没有机器能够通过,直到2014年6月,一位“13岁乌克兰男孩”出现在英国皇家学会举行的图灵测试大会上……

我们下次再聊。

(转载请取得授权,否则必究;本文图片源于网络,感谢原作者,若有侵权联系删除)

扫码下载APP

扫码下载APP

科普中国APP

科普中国APP

科普中国

科普中国

科普中国

科普中国