出品:科普中国

制作:张舒喻

监制:中国科学院计算机网络信息中心

眼睛受到不可逆转的损伤后,还能看得见吗?

神经科学发现,大脑有一种特殊天赋,能够不依靠眼睛,让天生的盲人学会“看东西”。

图片来源:veer图库

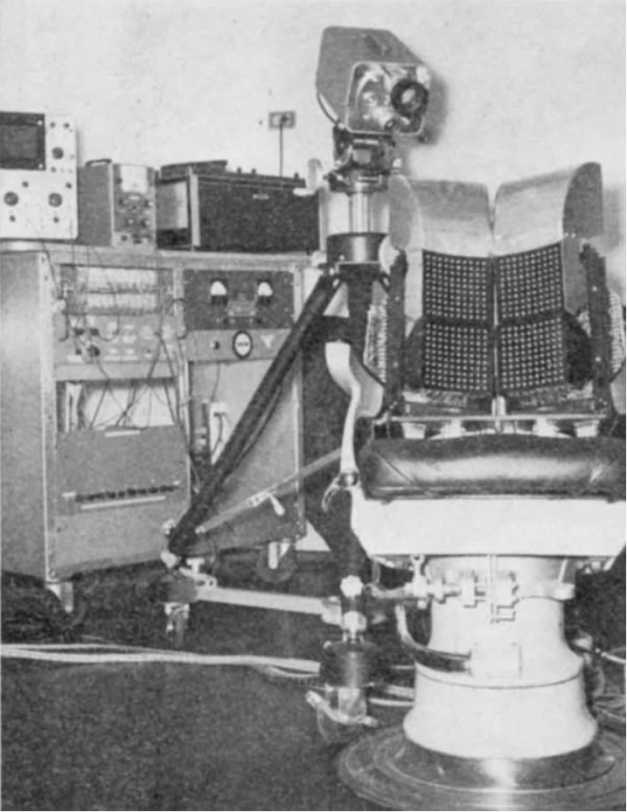

躺进“按摩椅”,先天盲人也能“看见”飞来的球

1969年,《自然》刊发了一篇颇具科幻色彩的论文,文中详细描述了一种很奇怪的仪器,通过“按摩”盲人的后背,能够让他们“看见”东西。

让我们还原一下实验情景:

一个先天盲人,没有任何视觉经验,躺在一张类似牙科治疗椅上。在他旁边安装了一台配有变焦镜头的老式摄影机。

治疗师用手摇的方式移动摄影机,来扫描盲人面前的景象。生成的影像被传送进身后的仪器中,仪器把经过处理的视觉信号,传输给治疗椅背上的刺激点矩阵。

具体来说,景象中光线弱的部分,对应的矩阵刺激点会震动,而光线强的部分,就不震动。这些触点会直接刺激盲人的后背皮肤,像是按摩椅一样。

巴赫-利塔发明的“助视神器”。图中镜头的位置朝向正好模拟人眼的视角,能使盲人感知面前的物体(图片来源:参考文献2 )

经过20-40个小时的密集训练后,神奇的事情发生了——盲人不仅能够区分垂直线、斜线和曲线等不同的线条,还能辨认圆形、长方形、三角形等常见的几何形状。

在学会操控摄影机后,透过变焦镜头,盲人能够瞄准房间的不同位置,来识别电话、椅子、杯子等各种物体(即使被部分地遮挡住),并描述它们之间的位置关系。

逐渐地,他们开始能感知到面前的三维立体空间:

物体的远近,能够导致图像产生大小变化;

从不同的视角观察物体,它的形状会被扭曲;

物体的背光面会投下阴影等。假如有人朝镜头扔一个球过来,盲人会很自然地躲避。

借助这个“触觉-视觉”(tactile-vision)仪器,盲人甚至还学会了辨识人脸(如,名模的脸孔)。

更不可思议的是,他们还能“观察到”人物的外表和举止的变化。

比如,他们描述某位女士:“她今天把长发放下来了,而且没有戴眼镜。她正把右手移到脑后。”

刺激点矩阵的振动模式在监控示波器上,投射出一个二维影像。

图像显示的是人脸形象。经过长时间的训练,盲人能够学会识别类似复杂程度的触感模式(图片来源:参考文献2)

为什么刺激后背,大脑就能够“看见”呢?

这项研究的主要负责人保罗•巴赫-利塔(Paul Bach-y-Rita),曾对使用盲杖的盲人,进行了细致的观察和研究。盲人在行走时,会前后扫动盲杖,盲杖的尖端经由皮肤上的触觉感受体,来告诉盲人路况信息。

巴赫-利塔深受启发:盲杖可以看作是盲人和物体之间的“接口”。通过盲杖在手上的压力触感,形成诸如房间摆设这样的空间信息。

因此,手上的皮肤及其触觉感受体,就像一个信息收集站。它们可以替代视网膜,使图像在大脑中形成。

“按摩椅”正是以类似的方式,让盲人能够“看见”。简单来讲,这是大脑在看东西,而不是眼睛。

图片来源:Pixabay

随机应变的大脑

巴赫-利塔的这项前瞻性实验结果,证实了“感官替代”(sensory substitution)理论。

具体而言,这是指负责视觉功能的重要神经通路,一旦断掉或被堵死,大脑就会绕道。

掌管触觉感受的神经通路,本来在视知觉中极少被用到,但是现在能作为替补上场,发挥“看东西”的作用。看来,大脑也懂得“条条大路通罗马”。

事实上,大脑很像一台待在黑暗脑壳里的解码器。当外界的各种感官信息输送进来后,不管这些信息是光子、空气压缩波、分子浓度,还是压力、质地或温度,都会被统一转换成脑中的通用语言:电化学信号。

正是这黑暗剧场里的生物化学反应,形成了我们对现实的所有感知。

图片来源:Pixabay

即使感知信号来自非同寻常的感觉神经通路,大脑也会迎难而上,通过不断地学习、理解新的信号,来重新组织感官知觉。

这要归功于几百万年的生物进化,将大脑打造成了随机应变的“大咖”。化腐朽为神奇的超强学习能力,正是源于人类大脑神经的灵活可塑性。

巴赫-利塔是将大脑神经的可塑性,运用于复健医学的先驱。

继“按摩椅”之后,世界上涌现出了一些更现代化的设计。比如,通过给耳朵输送声音,或是采用小幅振动刺激前额或舌头的方式,来向大脑传递视觉信息。不用眼睛,也能“看见”。乍一听,这像是特异功能。但细想来,这也是大脑正常运作的结果。

无独有偶,听觉也可以不依赖耳朵。

另类方式“聆听”世界

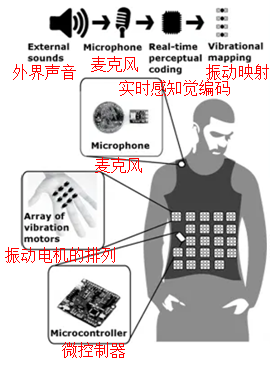

神经科学家大卫·伊格曼(David Eagleman)团队为听障人士,精心设计了一款助听神器——可变超感官传感器(Variable Extra-Sensory Transducer, 即VEST,俗称“背心”)。

“背心”自带麦克风,能对外界声音进行实时感知觉编码(real-time perceptual coding)。

编码信息随即映射给“背心”上的一些微小振动电机。电机能根据声音的频率,激活动态的振动模式,再传送给整个躯干。

“背心”的工作原理 (图片来源:eagleman.com )

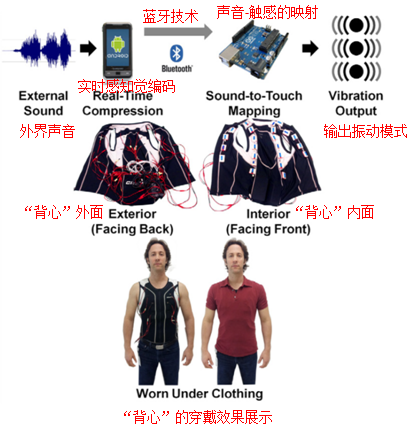

这项可穿戴技术也能在手机、平板电脑等移动设备上运行。设备一旦捕捉到环境里的声音,就会通过蓝牙将信号映射到电机上。

“背心”在移动设备条件下的工作原理(上);“背心”的正反面(中);伊格曼展示“背心”的穿戴效果(下)(图片来源:参考文献3)

适应“背心”发出的振动信号,就像是在学习一种新的语言。 起初,这些外来信号难以捉摸。但经过足够的训练,大脑会交叉对比不同的后背触感,并逐渐学会从中提取规律,把“背心”的语言,转换成能够理解的信息。比如,大脑能将某个词语与具体的振动模式匹配起来。

实验表明,每天穿“背心”2小时,在不到一周的时间里,听障人士就能将他人说出的单词,正确地拼写出来。

伊格曼表示,这项专利技术不仅能为患者免去耳蜗移植手术带来的侵害,而且有望让他们获得直接的听觉感受体验。这就类似盲人通过触摸盲文,来理解文字的含义。

故事还没结束,后续工程师们又神来一笔!他们将“背心”的核心技术,浓缩进了一个小巧的手环里,并给它起了一个生动形象的名字——“Buzz”,意为“发出嗡嗡声”。

手环的界面安装有电源开关、用户设置按钮、一个麦克风以及一个微控制器。(图片来源:Neosensory.com )

手环虽小,但功能俱全。它配有1个捕捉环境声音的麦克风、4个振动电机以及精密的信号处理系统。该系统能像“背心”那样,将外界信号经由“声音-触感”(sound-to-touch)算法编码后,转化成电机输出的动态振动模式。

麦克风捕捉到的声音信号,经过微控制器处理后,转化成4个电机输出的不同振动模式。每个振动点是8.2mmX8.5mm的长方形区域 (图片来源:参考文献1)

仅仅只有4个振动刺激点的手环,能传递出足够多的触感信号吗?

研究团队在失聪和听力严重受损的18名患者身上,进行了为期一个月的监测。在这段时间的日常生活中,患者每天至少佩戴手环4小时。从刚佩戴手环的那天起,患者每隔两周接受一轮测试。

数据显示,患者能够学会区分由单词音频转化而成的不同振动模式。并且,他们也能辨认出,来自相似但不同单词的振动模式。

进一步研究后发现,患者还能学会识别日常生活里的声音。他们的学习素材涉及婴儿的哭泣声、汽车喇叭声、闹钟声以及鼓掌声等14个类别。

令人欣喜的是,他们的识别能力随着佩戴天数的增加而提高。

图片来源:Pixabay

事实证明,随着对手环功能的不断适应,佩戴者逐渐变得能更好地感知周围的声波世界。

美好的故事仍在继续。相信手环能为更多的听障人士带去希望。

人类大脑特有的这种化腐朽为神奇的学习能力,为受限的感官知觉,带来了全新的可能。

参考文献:

1. Perrotta, M. V. , Asgeirsdottir, T. , & Eagleman, D. M. . (2021). Deciphering sounds through patterns of vibration on the skin. Neuroscience (4).

2. Bach-Y-Rita, P. , Collins, C. C. , Saunders, F. A. , White, B. , & Scadden, L. . (1969). Vision substitution by tactile image projection. Nature, 221, 963–964.

3. Novich, S. D. , & Eagleman, D. M. . (2014). A vibrotactile sensory substitution device for the deaf and profoundly hearing impaired. 2014 IEEE Haptics Symposium (HAPTICS). IEEE.

4. 诺曼·道伊奇 《重塑大脑,重塑人生》(2015)机械工业出版社

5. 大卫·伊格曼 《大脑的故事》(2019) 浙江教育出版社

6. 我们能为人类创造新感官吗?| TED

7. https://www.ted.com/talks/david_eagleman_can_we_create_new_senses_for_humans/transcript?language=zh-cn

扫码下载APP

扫码下载APP

科普中国APP

科普中国APP

科普中国

科普中国

科普中国

科普中国